单细胞转录组下游的降维聚类分群这样的基础操作相信大家应该是都没有问题了,参考前面的例子:人人都能学会的单细胞聚类分群注释 ,只需要你有一个基于基因的表达量矩阵的分析。 Continue reading

不是maf格式的somatic突变数据就没办法读入到maftools了么

疫情期间发布了《肿瘤基因测序数据分析》课程,:

不同癌症的差异难道大于其与正常对照差异吗?

前面的教程:[大样本量多分组表达量矩阵分析你难道没想到单细胞吗](https://mp.weixin.qq.com/s/p2oYAgG-LO9yLGx1r3i9zQ),提到了我们整合全部的33种癌症的仅仅是蛋白质编码基因的表达量矩阵,进行降维聚类分群可以看到并不是严格的各个癌症泾渭分明。而去还别出心裁的引入了单细胞经典seurat流程,进行降维聚类分群。 Continue reading

把单细胞表达量矩阵换一个单位

一般来说单细胞表达量矩阵都是以基因为单位,我们可以很容易走常规的降维聚类分群并且合理的进行生物学命名,比如我们对官方 pbmc3k 例子,跑标准代码: Continue reading

癌症居然有如此多种(是时候开启pan-cancer数据挖掘模式)

看到了交流群有人提问某个癌症,看起来并不是TCGA的33种,我就搜索了一下,找到了 https://www.cancer.gov/types 这个宝藏网页,确实没想到癌症居然这么多种。 Continue reading

2014年测了近600样品的转录组芯片但是仅发表在 PLoS One

最近逛GEO,居然发现了一个神奇的数据, 在:(accession number GSE50832). 之所以说它神奇,是因为它关联的文章是 PLoS One 2014;9(8):e106131. PMID: 25171249, 标题是:《Gene expression profiling reveals epithelial mesenchymal transition (EMT) genes can selectively differentiate eribulin sensitive breast cancer cells》。因为它这个数据集样本量超级大,使用的是最经典的芯片,Affymetrix Human Genome U133 Plus 2.0 Array,做了近600样品。

因为涉及到3个不同的癌症细胞系,所以这个数据集可以拆分成为下面的3个 :

GSE50811 Breast cancer cell lines treated with eribulin and paclitaxel

GSE50830 Endometrial cancer cell lines treated with eribulin and paclitaxel

GSE50831 Ovarian cancer cell lines treated with eribulin and paclitaxel

这600样品的转录组芯片,总共是67个细胞系,对照和2种处理,各自3个重复,如下所示:

- 27 breast, 19 endometrial, and 21 ovarian cancer cell lines treated with eribulin and paclitaxel.

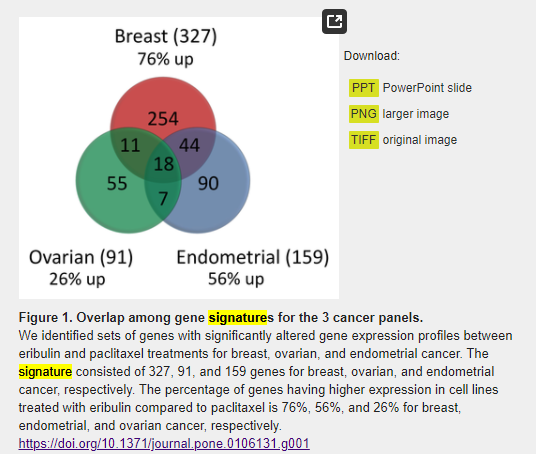

非常诡异的是,作者这里主要是关心 signature genes were up-regulated for eribulin treatment as compared to paclitaxel , 使用的阈值是 p values and fold-changes (p<0.01 and FC>1.5), 3种癌症细胞系,得到了如下所示的韦恩图交集结果:

差异分析相信大家都不陌生了,基本上看我六年前的表达芯片的公共数据库挖掘系列推文即可; - 解读GEO数据存放规律及下载,一文就够

- 解读SRA数据库规律一文就够

- 从GEO数据库下载得到表达矩阵 一文就够

- GSEA分析一文就够(单机版+R语言版)

- 根据分组信息做差异分析- 这个一文不够的

- 差异分析得到的结果注释一文就够

但是作者这样的分析简直是对数据的莫大浪费啊!

3个分组的两两之间差异分析

总是有粉丝询问3个分组的两两之间差异分析如何弄这样的问题,其实“师傅领进门,修行在个人”,我们讲解了方法并且给予的全部的学习资源,理论上后续应该是大家各凭本事,做好自己的科研。 Continue reading

你的单细胞数据里面能区分出来4种树突细胞吗

我们做肿瘤研究的单细胞数据,一般来说会选择初步很粗狂的定义大的细胞亚群,比如我常用的 第一次分群是通用规则是: Continue reading

25张图带你玩转表达量差异分析思路

最近看到了很多借助 单细胞水平的不同细胞亚群的差异来解释以前的传统转录组混合各种细胞亚群的样品差异的文章, 如下所示: Continue reading

95元每年的云服务器配2021的Linux公益课最香

细心的朋友们应该是早就发现了,咱们《生信技能树》的公益课130个小时视频更新啦,而且统一搭配了颜值超高的封面图,诚意满满的吸引你前往学习哦! Continue reading

2021第一期生信入门微信群答疑精选200题

原文链接:https://docs.qq.com/doc/DSFdmRGR0SWhMTmNI

-

备注:Q-Question,A-Answer,T-Teacher,S-Student。 Continue reading

把单细胞亚群单独提取出来进行后续再分析

前面我们假设自己的生物学背景不够,所以不需要把T细胞分成 “Naive CD4 T” , “Memory CD4 T” , “CD8 T”, “NK” 这些亚群,可以合并为T细胞 Continue reading

表达量矩阵并不一定要上传到GEO或者ArrayExpress

最近在系统性整理单细胞转录组图谱计划,发现了一个有意思的数据共享方式,就是2018的小鼠单细胞图谱,文章标题是:《A single-cell transcriptomic atlas characterizes ageing tissues in the mouse》,链接 Continue reading

不同转录组数据处理流程对生物学意义挖掘的影响

转录组数据处理流程大家应该是耳熟能详了,拿到了测序fastq数据,质量控制,比对,然后定量拿到表达矩阵即可走差异分析流程, Continue reading

不要看数量要看质量(你的脑子才是睾丸)

大家在做差异分析结果比较的时候,喜欢看两次分析结果的基因交集,比如韦恩图。这样的简单粗暴的思考逻辑很容易理解,但是就会 Continue reading

不知道你的单细胞分多少群合适,clustree帮助你

我们以 seurat 官方教程为例:

差异分析要的是表达量矩阵,基因名字并不重要啊

太多人咨询基因的各种ID转换问题,在非模式生物的物种里面更麻烦,因为数据库注释资源并不权威。 Continue reading

代谢产物差异分析

咱们《生信技能树》公众号一直缺乏宏基因组数据分析,还有蛋白质组学,代谢组的笔记,是时候补充起来了。主要是因为我们着重于基 Continue reading

单细胞混样测序至少可以区分性别

记录一下看到的单细胞文献里面有意思的数据分析现象,希望给读者朋友们也带来一点启发! Continue reading

单细胞亚群标记基因何止五种可视化方法

以前我们做了一个投票:可视化单细胞亚群的标记基因的5个方法,下面的5个基础函数相信大家都是已经烂熟于心了: Continue reading